Как да напишете перфектния prompt: 10 техники [2026]

Научи 10 доказани техники за писане на перфектния prompt за ChatGPT, Claude и Gemini. Примери, структури и best practices от OpenAI и Anthropic за 2026.

Накратко: В това ръководство ще научите 10 доказани техники за писане на перфектния prompt, подкрепени с официалните добри практики от OpenAI, Anthropic и Google. Следвайки стъпките тук, ще получавате по-точни, по-полезни и по-предвидими резултати от ChatGPT, Claude и Gemini — веднага след прочитането.

Ключови факти:

- 80% от предприятията се очаква да използват генеративен AI до 2026 г.

- Оптималната дължина на prompt-а е 150–300 думи (изследване на Levy, Jacoby и Goldberg, 2024)

- LLM производителността намалява около 3 000 токена — далеч под техническите максимуми

- ChatGPT Plus ($20/месец) предлага GPT-4o, по-дълъг контекст и функции като Projects и Canvas

- Reddit общността r/ChatGPT има над 11 милиона членове — най-голямата практическа база от знания

- Пазарът на prompt engineering е оценен на USD 505 милиона и расте с над 30% годишно.

- 10 техники, 3 модела (ChatGPT, Claude, Gemini), 1 чек-лист за самопроверка

Защо перфектния prompt е важен за всеки специалист през 2026?

Какво е prompt? Prompt (или AI заявка) е текстова инструкция, която изпращате към езиков модел (LLM) като ChatGPT, Claude или Gemini. Prompt-ът определя задачата, контекста, ограниченията и очаквания формат на изхода. Качеството на prompt-а пряко влияе върху качеството на AI отговора.

Prompt engineering — умението да напишете перфектния prompt — вече не е нишова техника за разработчици. Според анализа на Gartner, 80% от предприятията се очаква да използват генеративен AI до 2026 г., а способността да комуникирате ефективно с AI модели е основна компетентност за всеки специалист. Пазарът на prompt engineering е оценен на USD 505 милиона и расте с над 30% годишно — сигнал, че това умение носи реална стойност.

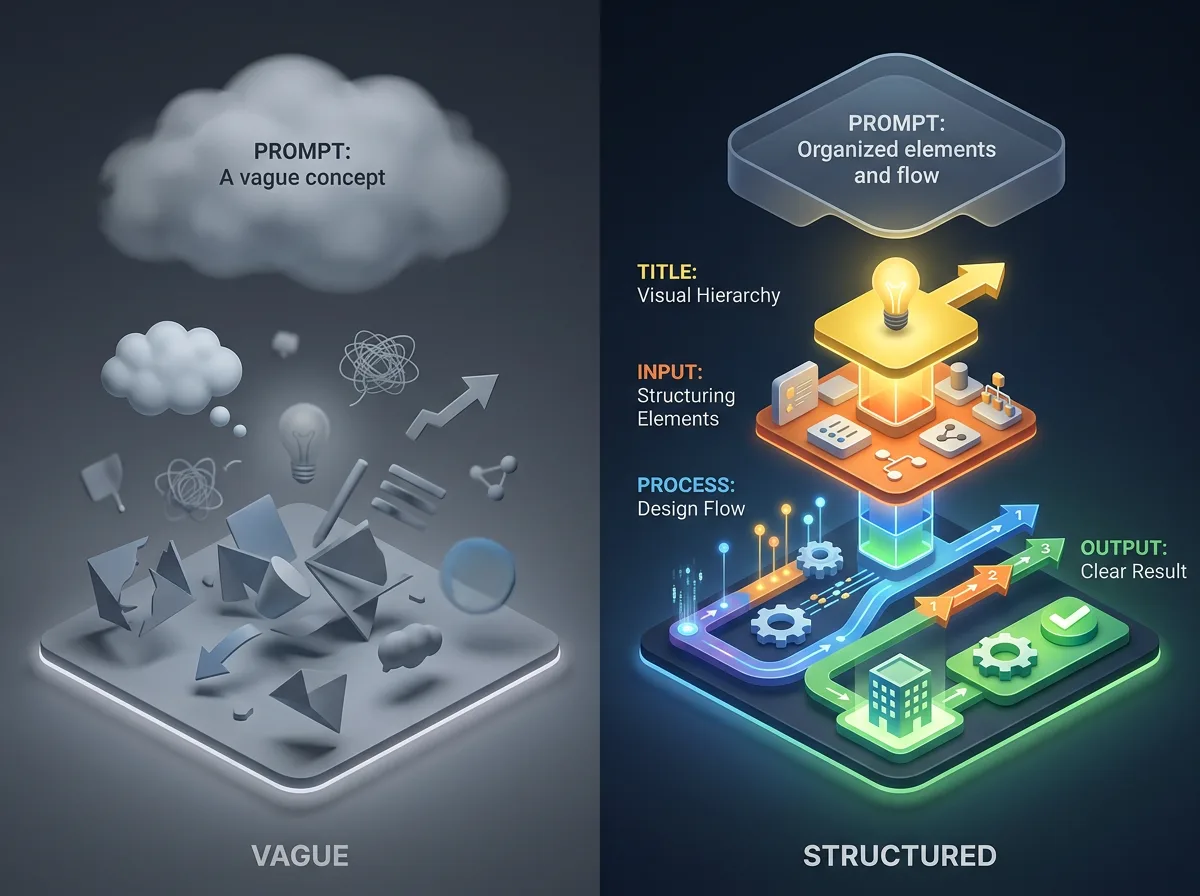

Разликата между неясен и ясен prompt е огромна на практика. Помислете за следния пример:

- Неясен prompt: "Напиши нещо за климата."

- Ясен prompt: "Напиши резюме от 3 абзаца за климатичните промени, предназначено за ученици в средното образование, с bullet points и неутрален тон."

Вторият prompt дава конкретен формат, аудитория, тон и обем. Резултатът е предвидим и използваем — без допълнително редактиране.

За България темата е особено актуална — страната е сред лидерите в Източна Европа по брой AI стартъпи на глава от населението, а българските специалисти работят активно с ChatGPT, Claude и Gemini на български и английски. Умението да структурираш перфектния prompt е конкурентно предимство на българския пазар, където AI инструментите вече са стандарт в маркетинга, разработката и бизнес анализа.

Важно е да разберете, че успехът не зависи от дължината на prompt-а. Изследване на Levy, Jacoby и Goldberg (2024) показва, че производителността на LLM намалява около 3 000 токена — далеч под техническите максимуми на контекстния прозорец. Практическата оптимална дължина за повечето задачи е 150–300 думи. Повече не означава по-добре.

Какво ви трябва, за да напишете перфектния prompt?

Преди да приложите техниките, уверете се, че имате следното:

- Акаунт в ChatGPT, Claude или Gemini — безплатният tier е достатъчен за начало; ChatGPT Free ($0) обработва повечето примери в ръководството

- ChatGPT Plus ($20/месец) — препоръчително за сериозна работа (GPT-4o, Projects, Canvas, по-дълъг контекст)

- Основни познания по английски — официалната документация на OpenAI и Anthropic е на английски, но техниките работят еднакво добре на български

- Конкретна задача — имайте предвид реален проблем, който искате да решите с AI

- Очаквано време: 30–45 минути за прочитане и прилагане на всички 10 техники

Как да напишете перфектния prompt: 10 доказани техники

Техника 1: Ясност и специфичност — основата на всеки добър prompt

Ясността е най-фундаменталната техника при писането на перфектния prompt. Според официалните добри практики на OpenAI, prompt-ите трябва да бъдат ясни, специфични и да предоставят достатъчно контекст — двусмислието е основният враг на качествения изход.

Ето три конкретни примера:

| Тип | Prompt | Проблем |

|---|---|---|

| Лош | "Напиши имейл" | Без контекст, тон, получател |

| Добър | "Напиши имейл до клиент за забавена доставка" | Има контекст, но липсва тон и дължина |

| Перфектен | "Напиши кратък имейл (3–4 изречения) до клиент, чиято доставка е закъсняла с 3 дни. Тон: извинителен, но уверен. Включи конкретна дата за нова доставка: 25 март." | Конкретен формат, тон, детайли |

Важно е да знаете, че подробните prompt-и могат да доведат до излишна дължина на изхода. Всеки LLM има token limit (напр. 128K токена за GPT-4o) — процесът на tokenization преобразува текста ви в токени, като 1 дума ≈ 1.3 токена. Оптималната дължина на prompt-а е 150–300 думи — достатъчно за контекст, без да претоварвате модела.

Техника 2: Структурирана подготовка — INSTRUCTIONS / INPUTS / CONSTRAINTS / OUTPUT

Структурираният prompt е по-лесен за следване и за отстраняване на грешки. OpenAI препоръчва разделяне на prompt-а на четири ясни части, вместо смесване на всичко в един блок.

Четирите компонента:

- INSTRUCTIONS — какво точно трябва да направи моделът

- INPUTS — данните, с които работи

- CONSTRAINTS — ограничения (дължина, тон, формат, какво да избягва)

- OUTPUT FORMAT — точната структура на изхода

Ето пълен пример:

INSTRUCTIONS:

Анализирай следния текст и извлечи ключовите аргументи.

INPUTS:

[Поставете текста тук]

CONSTRAINTS:

- Максимум 5 аргумента

- Само факти, без интерпретации

- Без директни цитати

OUTPUT FORMAT:

Номериран списък с формат:

1. [Аргумент] — [Кратко обяснение, 1 изречение]

Тази структура е особено ефективна при работа с Claude модели, тъй като те следват инструкциите буквално. Ако не посочите нещо изрично, Claude няма да го включи в изхода.

Техника 3: Role-based prompting — даване на персона на модела

Role-based prompting подобрява качеството на изхода, особено за специализирани задачи. Когато зададете роля на модела, той активира по-специфичен речник, стил и подход към проблема.

Примери за ефективни роли:

"Вие сте старши backend инженер с 15 години опит

в разпределени системи. Прегледайте следния код

и посочете потенциални проблеми с производителността."

"Вие сте опитен маркетолог, специализиран в B2B SaaS.

Напишете LinkedIn пост за нова функция на продукта."

"Вие сте редактор на академично списание.

Прегледайте следния абзац за яснота и точност."

Важно предупреждение: агресивният език в prompt-ите (фрази като "CRITICAL!", "YOU MUST", "NEVER FAIL") може да навреди на качеството на изхода при по-новите версии на Claude. Придържайте се към ясни, уважителни инструкции — резултатите са по-добри.

Техника 4: Few-shot prompting — силата на примерите

Few-shot prompting остава една от техниките с най-висок ROI при работа с LLM модели. Вместо да обяснявате какво искате с думи, показвате 1–3 примера на желания изход.

Пример без few-shot (по-слаб резултат):

Напиши кратко описание на продукт. Бъди кратък и професионален.

Пример с few-shot (по-надежден резултат):

Напиши кратко описание на продукт по следния модел:

Пример 1:

Продукт: Безжични слушалки

Описание: Кристален звук, 30 часа батерия, активно шумопотискане.

Идеални за работа от вкъщи и пътуване.

Пример 2:

Продукт: Смарт часовник

Описание: Следи здравето ви 24/7, GPS навигация,

5 дни батерия. Съвместим с iOS и Android.

Сега напиши описание за:

Продукт: Преносима колонка

GPT-5 е добър в извличане на намерение от минимален контекст, така че zero-shot понякога работи. Въпреки това, few-shot prompting винаги дава по-предвидими и по-надеждни резултати — особено за формати като JSON, CSV или структурирани списъци.

Техника 5: Chain-of-thought prompting — видимост на разсъждението

Chain-of-thought (CoT) prompting моли модела да подражава на човешкия процес на разсъждение при производство на изходи. Техниката е въведена от Wei et al. (2022) и доказва, че добавянето на "Нека разсъждаваме стъпка по стъпка" увеличава точността на GPT и PaLM модели с 10-40% при математически и логически задачи. Целта е да се увеличи точността при сложни задачи чрез видимост как моделът е стигнал до конкретен извод.

Пример за chain-of-thought prompt:

Реши следния проблем стъпка по стъпка:

Компания А продава 150 единици на ден при цена 25 лв.

Компания Б продава 90 единици на ден при цена 40 лв.

Коя компания генерира повече приходи седмично?

Нека разсъждаваме стъпка по стъпка:

1. Изчисли дневните приходи на всяка компания

2. Изчисли седмичните приходи

3. Сравни резултатите

4. Дай финален отговор

Тази техника е особено ефективна за математически задачи, логически проблеми и многостъпков анализ на текст. Имайте предвид, че chain-of-thought увеличава дължината на изхода и може да намали скоростта на отговора — използвайте я само когато прозрачността на разсъждението е важна.

Техника 6: Model-specific подход — ChatGPT срещу Claude срещу Gemini

Различните модели изискват различни подходи при писането на перфектния prompt. Разбирането на тези разлики е ключово за максимална ефективност.

| Критерий | ChatGPT | Claude | Gemini |

|---|---|---|---|

| Структура | Markdown (##, -) | XML тагове | Markdown или проза |

| Следване на инструкции | Гъвкаво | Буквално | Умерено |

| Агресивен тон | Толерантен | Избягвайте | Толерантен |

| Примери (few-shot) | Работи добре | Работи отлично | Работи добре |

| Дълги промпти | Добра обработка | Отлична обработка | Добра обработка |

| Специфика | Гъвкав | XML структура | Мултимодален |

Пример за Claude с XML структура:

<instructions>

Анализирай следния имейл и предложи подобрения.

</instructions>

<context>

Имейлът е до потенциален клиент за B2B SaaS продукт.

</context>

<example>

Добър тон: "Бихме искали да ви покажем как..."

Лош тон: "Трябва да закупите нашия продукт..."

</example>

<input>

[Поставете имейла тук]

</input>

За повече информация за Claude моделите вижте нашия преглед на Claude Code 2.0 и как се справя при реални задачи за програмиране.

Техника 7: Reasoning effort параметър — баланс между скорост и качество

Reasoning effort е ключов параметър (наред с temperature и системните инструкции) при работа с по-новите модели, включително тези, описани в нашия преглед на GPT-5 новите функции. Параметърът reasoning_effort се задава на три нива и определя колко "дълбоко" мисли моделът.

| Ниво | Приложение | Скорост | Цена |

|---|---|---|---|

| Low | Резюмета, прости въпроси, класификация | Бърза | Ниска |

| Medium | Писане на съдържание, анализ, превод | Умерена | Умерена |

| High | Сложни математически задачи, многостъпков анализ, код | Бавна | По-висока |

Пример за задаване на reasoning effort в prompt:

[reasoning_effort: low]

Обобщи следния текст в 3 изречения.

[reasoning_effort: high]

Анализирай следния бизнес план и идентифицирай

потенциалните рискове, като разсъждаваш стъпка по стъпка.

High reasoning е по-скъп и по-бавен — използвайте го само за задачи, при които точността е критична. За ежедневни задачи като резюмета и прости въпроси, Low или Medium са напълно достатъчни. Комбинирайте reasoning effort с подходящ temperature параметър (0.0–0.3 за точност, 0.7–1.0 за креативност) и системни инструкции (system prompt), които задават контекста на цялата сесия.

Техника 8: Meta-prompting и уточняващи въпроси — откритието на 2025

Meta-prompting е техниката, при която инструктирате модела да задава уточняващи въпроси преди да отговори. Според анализ на r/ChatGPT (над 11 милиона членове), мета-prompt-ите са получили три пъти повече upvotes от всякакъв content-specific prompt в mega-thread с 2 000+ коментара от 2025 г.

Пример за мета-prompt:

Преди да отговориш на моята задача, задай ми

3–5 уточняващи въпроса, които ще ти помогнат

да дадеш по-точен и полезен отговор.

Задачата ми е: Искам да напиша маркетинг стратегия

за новия си продукт.

Моделът ще попита за целевата аудитория, бюджета, канала за разпространение и конкурентите — преди да генерира стратегията. Резултатът е значително по-точен от директен отговор без контекст. Тази техника е особено полезна за сложни задачи, при които не сте сигурни какъв контекст е нужен.

Техника 9: Самопроверка и валидация — гарантиране на качество

Самопроверката е вградена в prompt-а инструкция, която моли модела да провери собствения си изход преди да го представи. Не разчитайте на "изглежда добре" — добавете конкретен чек-лист.

Пример за prompt със самопроверка:

Напиши резюме на следния документ.

След като напишеш резюмето, провери:

☐ Изходът съотговорства точно на търсения формат

☐ Всички ключови точки от оригинала са включени

☐ Твърдения без достатъчно подкрепа в текста

са маркирани като [UNCERTAIN]

☐ Дължината е между 150 и 200 думи

Ако някоя точка не е изпълнена, коригирай изхода.

Тази техника е особено ценна при анализ на документи, генериране на код и задачи, при които точността е критична. Маркирането на несигурни твърдения с [UNCERTAIN] е ефективен начин за намаляване на hallucination-и.

Техника 10: Итерирай и тествай — практиката е ключът

Най-добрият начин да научите как да напишете перфектния prompt е практика. Prompt engineering не е еднократна задача — това е итеративен процес.

5-стъпков процес за итерация:

- Напишете начален prompt — прилагайте техниките от това ръководство

- Тествайте го — изпратете го към модела и анализирайте изхода

- Идентифицирайте проблемите — какво липсва, какво е излишно, какво е неясно

- Усъвършенствайте — добавете контекст, примери или ограничения

- Повторете — тествайте отново до получаване на желания резултат

Според официалното ръководство на OpenAI: "Write clear instructions — if outputs are too long, ask for brief replies. If outputs are too simple, ask for expert-level writing." Простотата и итерацията са по-ефективни от сложността.

Реални примери за ефективни AI заявки

Теорията е полезна, но нищо не заменя реалните примери. Ето три конкретни сценария — маркетинг, код и анализ — с лош и перфектен prompt за всеки.

Пример 1: Писане на маркетинг копие

Лош prompt:

Напиши реклама за нашия продукт.

Перфектен prompt с пълна структура:

INSTRUCTIONS:

Напиши Facebook реклама за SaaS инструмент за управление на задачи.

INPUTS:

- Продукт: TaskFlow Pro

- Целева аудитория: Мениджъри на малки екипи (5–20 човека)

- Основна полза: Спестява 3 срещи на седмица чрез автоматични отчети

CONSTRAINTS:

- Максимум 90 думи

- Без технически жаргон

- Включи призив към действие

- Тон: приятелски, но професионален

OUTPUT FORMAT:

Заглавие (максимум 10 думи)

Основен текст (2–3 изречения)

Призив към действие (1 изречение)

За повече примери как AI се използва в маркетинга вижте нашия материал за AI автоматизация.

Пример 2: Генериране на код

Лош prompt:

Напиши Python код за четене на CSV файл.

Перфектен prompt:

INSTRUCTIONS:

Напиши Python функция за четене и валидиране на CSV файл.

INPUTS:

CSV файл с колони: name (string), age (integer), email (string)

CONSTRAINTS:

- Използвай pandas библиотека

- Обработвай грешки с try/except

- Валидирай: age е между 18 и 120, email съдържа @

- Добави docstring на английски

- Python 3.10+

OUTPUT FORMAT:

Само кода, без обяснения.

Включи пример за извикване на функцията в коментар.

За сравнение на AI инструменти за програмиране вижте нашия материал за AI генериране на снимки — там показваме как правилните prompt-и водят до драстично по-добри резултати при визуално съдържание.

Пример 3: Few-shot prompt за анализ на отзиви

Класифицирай следните клиентски отзиви като

ПОЗИТИВЕН, НЕГАТИВЕН или НЕУТРАЛЕН.

Пример 1:

Отзив: "Продуктът пристигна навреме и работи отлично!"

Класификация: ПОЗИТИВЕН

Пример 2:

Отзив: "Доставката закъсня с 5 дни. Разочарован съм."

Класификация: НЕГАТИВЕН

Пример 3:

Отзив: "Получих продукта. Ще го тествам."

Класификация: НЕУТРАЛЕН

Сега класифицирай:

Отзив: "Качеството е добро, но цената е висока за това, което получавате."

Кой подход за писане на перфектния prompt работи най-добре?

| Техника | Сложност | ROI | Най-добра за | Модел |

|---|---|---|---|---|

| Ясност/специфичност | Ниска | Висок | Всички задачи | Всички |

| INSTRUCTIONS структура | Средна | Висок | Сложни задачи | Claude, GPT |

| Role-based | Ниска | Среден | Специализирани | Всички |

| Few-shot | Средна | Много висок | Формати, JSON | Всички |

| Chain-of-thought | Средна | Висок | Анализ, математика | GPT, Claude |

| Meta-prompting | Ниска | Висок | Неясни задачи | ChatGPT |

Few-shot prompting и структурираната подготовка (INSTRUCTIONS/INPUTS/CONSTRAINTS/OUTPUT) дават най-висок ROI за повечето задачи. Meta-prompting е най-подходящ, когато задачата е сложна и не сте сигурни какъв контекст е нужен.

- ✓Структурираните промпти (INSTRUCTIONS/INPUTS/CONSTRAINTS/OUTPUT) правят изхода предвидим и лесен за отстраняване на грешки

- ✓Few-shot примерите елиминират нуждата от дълги обяснения - показвате вместо да разказвате

- ✓Meta-prompting значително подобрява точността при сложни или неясни задачи

- ✓Chain-of-thought увеличава прозрачността и намалява грешките при многостъпкови проблеми

- ✓Role-based prompting активира по-специфичен и качествен изход за специализирани области

- ✓Самопроверката намалява hallucination-ите и подобрява надеждността на изхода

- ×Структурираните промпти изискват предварително планиране и повече начално усилие

- ×Few-shot примерите увеличават дължината на промпта и консумират повече токени

- ×Chain-of-thought забавя отговора и увеличава разходите при платени API

- ×Различните модели изискват различни подходи - Claude иска XML, ChatGPT е по-гъвкав

- ×High reasoning effort е по-скъп и по-бавен - не е подходящ за прости задачи

- ×Итерацията отнема време - перфектният промпт рядко се постига от първия опит

Софтуер за оптимизиране на AI заявки (2026)

Освен ръчното писане на prompt-и, съществуват специализирани инструменти, които помагат за управление, тестване и оптимизация.

| Инструмент | Цена | За кого е подходящ | Основни функции |

|---|---|---|---|

| PromptLayer | $100+/месец | Production AI приложения | Versioning, logging, multimodal |

| LangSmith | Free + paid | LangChain тимове | Debugging, тестване, Prompt Canvas |

| Braintrust | Free + $100+/месец | Enterprise AI | AI co-pilot Loop, автоматична оптимизация |

| Langfuse | Open-source + managed | Тимове с нужда от контрол | Self-hosting, tracing, metrics |

| ChatGPT Free | $0 | Начинаещи | Ежедневни задачи, GPT-4o mini |

| ChatGPT Plus | $20/месец | Редовни потребители | GPT-4o, Projects, Canvas, памет |

За начинаещи, ChatGPT Free ($0) е напълно достатъчен за прилагане на всички техники в това ръководство. ChatGPT Plus ($20/месец) е препоръчителен за редовна работа — предлага GPT-4o, функции като Projects и Canvas за редактиране на дълги документи, и постоянна памет между сесиите.

Какви грешки да избягвате, когато пишете перфектния prompt?

Prompt engineering е практична умение и грешките са неизбежна част от процеса. Ето шестте най-чести проблема и как да ги избегнете.

1. Твърде дълги prompt-и (над 300 думи) Производителността на LLM намалява около 3 000 токена. Дръжте prompt-ите между 150 и 300 думи — достатъчно за контекст, без претоварване.

2. Неясни инструкции без примери "Бъди кратък и професионален" е неясна инструкция. Вместо това, покажете пример на желания изход — few-shot prompting решава този проблем директно.

3. Агресивен или заплашителен тон Фрази като "CRITICAL!", "YOU MUST NEVER" или "IMPORTANT!!!" могат да навредят на качеството на изхода при Claude модели. Придържайте се към ясни, уважителни инструкции.

4. Смесване на контекст и инструкции в един блок Когато всичко е в един параграф, моделът трудно разграничава какво е данни и какво е инструкция. Използвайте структурата INSTRUCTIONS/INPUTS/CONSTRAINTS/OUTPUT.

5. Липса на формат за изхода Без конкретен OUTPUT FORMAT, моделът избира структурата сам — понякога неподходящо. Винаги посочвайте дали искате bullet points, JSON, таблица или проза.

6. Неправилен подход за конкретния модел Claude следва инструкциите буквално и работи най-добре с XML тагове. ChatGPT е по-гъвкав. Gemini е оптимизиран за мултимодални задачи. Прилагайте правилния подход за правилния модел.

7. Пренебрегване на сигурността (prompt injection) Когато вграждате потребителски вход в prompt-а, винаги отделяйте данните от инструкциите — например чрез XML тагове или ясни разделители. Prompt injection е атака, при която злонамерен текст във входа "пренаписва" вашите инструкции. Това е особено важно при production AI приложения.

За по-широк контекст относно отговорното използване на AI вижте нашия материал за Етика на AI.

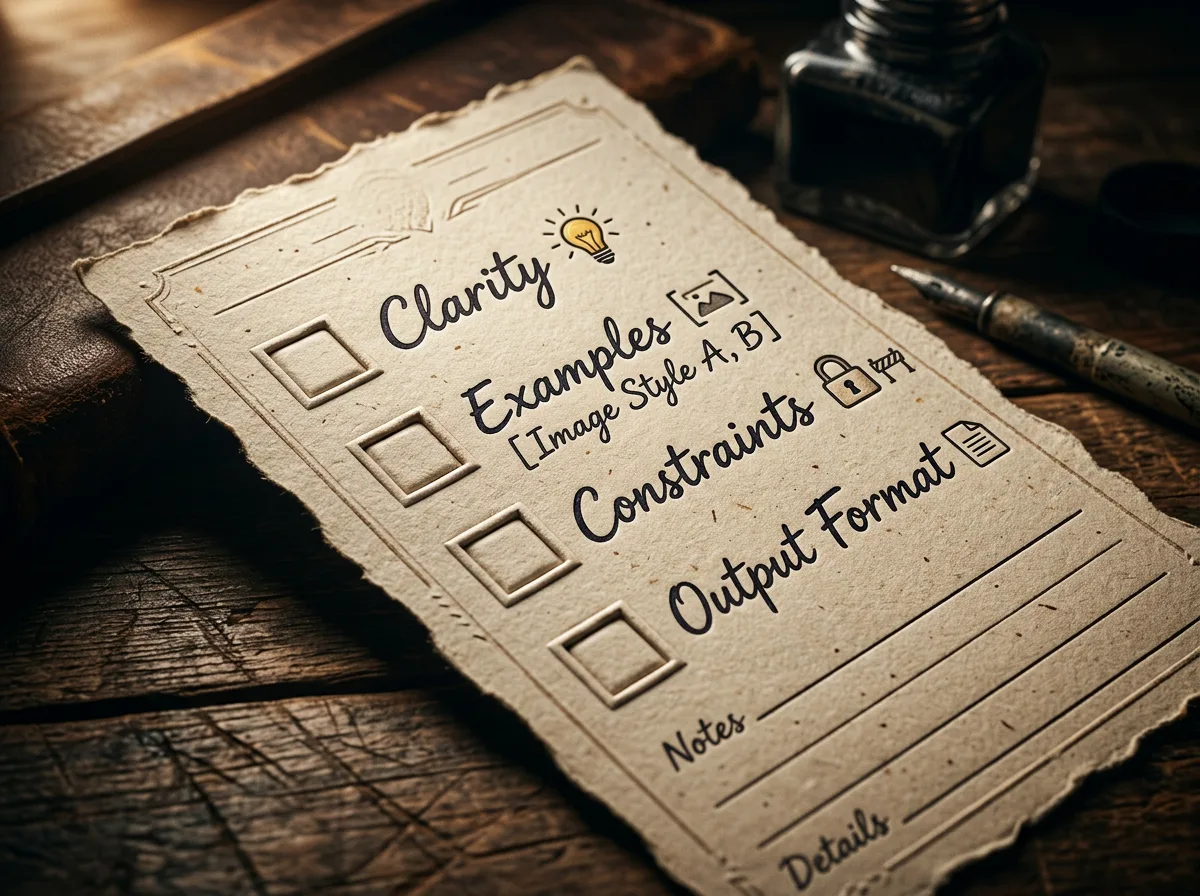

Чек-лист за перфектния prompt: готов ли е за изпращане?

Преди да изпратите prompt-а, проверете следното:

ЧЕК-ЛИСТ ЗА ПЕРФЕКТЕН PROMPT

Ясност и структура:

☐ Инструкцията е конкретна и без двусмислие

☐ Контекстът е отделен от инструкциите

☐ Дължината е между 150 и 300 думи

Съдържание:

☐ Добавен е поне 1 пример (few-shot) при нужда от специфичен формат

☐ Ограниченията са изрично посочени (дължина, тон, какво да се избягва)

☐ OUTPUT FORMAT е дефиниран

Модел-специфично:

☐ За Claude: използвани са XML тагове

☐ За ChatGPT: Markdown структура е приложена

☐ Агресивен език е избегнат

Качество:

☐ Добавена е самопроверка при критични задачи

☐ Несигурните твърдения ще бъдат маркирани като [UNCERTAIN]

☐ Prompt-ът е тестван поне веднъж и итериран

Как да напишете перфектния prompt и да извлечете максимума от AI

Успехът при работа с AI модели зависи от разбирането на модела, не от дължината на prompt-а. Ето 6-стъпков процес, приложим веднага:

- Разберете задачата — дефинирайте ясно какво искате да постигнете

- Напишете ясен начален prompt — прилагайте техниките за ясност и специфичност

- Структурирайте го — използвайте INSTRUCTIONS/INPUTS/CONSTRAINTS/OUTPUT

- Добавете примери — few-shot prompting при нужда от специфичен формат

- Итерирайте — тествайте, анализирайте, усъвършенствайте

- Добавете самопроверка — за критични задачи включете вграден чек-лист

Както общността на r/ChatGPT (над 11 милиона членове) потвърждава: мета-prompt-ите и уточняващите въпроси последователно дават по-добри резултати от всякакъв "магически" prompt. Краткостта, точността и решаването на специфичен проблем са по-ценни от дължината.

Допълнителни ресурси за prompt engineering

- OpenAI Prompt Engineering Guide — официалната документация

- Anthropic Claude Prompting Guide — XML структура и добри практики за Claude

- Google AI Prompting Guide — официалното ръководство за Gemini

- Prompting Guide (общ) — независим ресурс с техники за всички модели

- r/ChatGPT — общност с над 11 милиона членове и реални примери

- Chain-of-Thought Prompting — Wei et al. (2022) — оригиналната научна статия за CoT техниката

- Same Task, More Tokens — Levy et al. (2024) — изследване за влиянието на дължината на входа върху reasoning

Често задавани въпроси за prompt engineering

Каква е оптималната дължина на prompt-а?+

Каква е разликата между промптване за ChatGPT и Claude?+

Как да избегна hallucination-и при писане на prompt-и?+

Струва ли си ChatGPT Plus за $20/месец?+

Какво е meta-prompting и кога да го използвам?+

Как работят техниките за prompt engineering на български?+

Заключение: следващите ви стъпки

Писането на перфектния prompt е умение, което се развива с практика. Десетте техники в това ръководство — от ясността и структурата до few-shot prompting и meta-prompting — са доказани добри практики от OpenAI, Anthropic и реалната общност на r/ChatGPT.

Направете това СЕГА: Вземете конкретна задача, която имате днес, и приложете структурата INSTRUCTIONS/INPUTS/CONSTRAINTS/OUTPUT. Сравнете резултата с предишния ви подход. Итерирайте поне веднъж. Разликата ще бъде измерима.

За да задълбочите знанията си, разгледайте нашия материал за AI обработка на документи — там ще намерите конкретни приложения на тези техники в реални работни процеси.

Основател на CyberNinjas.ai и Кибер Хора. Пише за AI инструменти, новини и практически ръководства.

Още статии

AI Ръководства21 мин.

AI Ръководства21 мин.Claude Code + Antigravity: от нула до AI оркестратор [2026]

Claude Code + Google Antigravity IDE — пълен наръчник: настройка, CLI команди, MCP сървъри, Skills, Hooks и агентна оркестрация стъпка по стъпка [2026].

AI Ръководства14 мин.

AI Ръководства14 мин.Claude Code + NotebookLM чрез MCP: пълен наръчник [2026]

Claude Code + NotebookLM чрез MCP — пълен наръчник за настройка стъпка по стъпка. Нулеви халюцинации, автономно проучване и citation-backed отговори [2026].

AI Ръководства11 мин.

AI Ръководства11 мин.Vertex AI Agent Designer: ръководство за начинаещи [2026]

Vertex AI Agent Designer е визуален low-code инструмент за създаване на AI агенти в Google Cloud. Стъпка по стъпка ръководство с примери и съвети [2026].