EU AI Act: Какво означава новата регулация за България 2026

EU AI Act влиза в пълна сила през август 2026. Узнай какви са задълженията, глобите до 35 млн. EUR и как да подготвиш бизнеса си за съответствие. Сравнения,.

Накратко: EU AI Act (Regulation EU 2024/1689) — първата всеобхватна правна рамка за изкуствен интелект в света — влезе в сила на 1 август 2024 г. и ще бъде напълно приложим от 2 август 2026 г. Всяка българска компания, която разработва или внедрява AI системи на европейския пазар, трябва да е в съответствие до тази дата или рискува глоби до 35 млн. EUR.

Ключови факти: EU AI Act (Regulation EU 2024/1689) — в сила от 1 август 2024. Пълно прилагане: 2 август 2026. Максимална глоба: 35 млн. EUR или 7% от световния оборот. Четири нива на риск. 27 държави членки. България трябва да създаде национален AI орган до август 2026.

Какво представлява EU AI Act?

EU AI Act е публикуван в Официалния вестник на Европейския съюз на 12 юли 2024 г. и влезе в сила на 1 август 2024 г. Законът установява риск-ориентиран подход, при който AI системите се класифицират в четири нива на риск — от напълно запретени до такива с минимален риск. Той е първата в света всеобхватна правна рамка, която регулира разработването, предлагането и използването на AI системи.

Прилагането на закона е поетапно. На 2 февруари 2025 г. влязоха в сила забраните на определени AI практики и изискванията за AI грамотност. На 2 август 2025 г. AI Office официално стана оперативен и влязоха в сила изискванията за GPAI модели. Пълната приложимост на разпоредбите за висок риск системи настъпва на 2 август 2026 г.

Законът унифицира регулирането на AI в целия вътрешен пазар на 27-те държави членки на ЕС. България като пълноправен член на ЕС е изцяло обхваната от неговите изисквания.

"Целта ни е да гарантираме, че AI се разработва и използва по начин, който зачита фундаменталните права, безопасността и етичните принципи." — Хена Виркунен, изпълнителен вицепрезидент на ЕК за технологичен суверенитет, сигурност и демокрация, Европейска комисия

Защо EU AI Act е важен за българския бизнес?

EU AI Act има екстериториално действие: всяка AI система, която засяга хора в ЕС, трябва да бъде в съответствие с него — независимо дали е разработена в България, САЩ или Азия. Това означава, че дори американски компании, чиито продукти достигат до европейски потребители, са задължени да спазват закона.

За българските компании последствията са конкретни. Всяка организация, която разработва, предлага или използва AI системи на пазара на ЕС, трябва да класифицира своите системи, да изгради система за управление на риска и да обучи служителите си. Неподчинението не е теоретичен риск — глобите достигат до 35 млн. EUR или 7% от световния годишен оборот.

България трябва да установи национални компетентни органи по AI Act и поне един AI регулаторен пясъчник на национално ниво до 2 август 2026 г. Официалният текст на закона е достъпен на български език на адрес: https://eur-lex.europa.eu/legal-content/BG/TXT/?uri=CELEX:32024R1689.

Законът е особено важен за стартъпи и IT компании, които разработват системи за наемане, кредитен скоринг, медицинска диагностика или критична инфраструктура — всички те попадат в категорията „висок риск" с най-строги изисквания. За повече контекст относно етика на AI и принципите зад надеждните AI системи, вижте нашата специална статия по темата.

EU AI Act: Какви са четирите нива на риск?

EU AI Act класифицира всички AI системи в четири категории въз основа на потенциалния им риск за обществото.

1. Запретени практики (Неприемлив риск) — Член 5 на закона, в сила от 2 февруари 2025 г., забранява системи като: социално скоринг (оценяване на поведението на граждани от публични органи), биометрична категоризация на хора по чувствителни характеристики, системи за разпознаване на емоции на работното място или в образованието, и манипулативни системи като deepfakes за политически цели. Нарушенията подлежат на глоби до 35 млн. EUR или 7% от световния оборот.

2. Висок риск — Системи, които засягат безопасността или фундаменталните права. Примери: AI за подбор на персонал и оценка на служители, системи за кредитен скоринг и застраховки, AI в управление на критична инфраструктура (електроснабдяване, водоснабдяване), системи за медицинска диагностика, и AI в правосъдието. Тези системи имат най-строги изисквания и пълната им регулация влиза в сила на 2 август 2026 г.

3. Ограничен риск — Системи като chatbot-ове за обслужване на клиенти. Основното изискване е прозрачност: потребителите трябва да знаят, че взаимодействат с AI.

4. Минимален риск — Системи като филтри за спам или AI в компютърни игри. За тях няма специфични задължения по закона.

EU AI Act: Кои AI практики са забранени?

Член 5 на EU AI Act влезе в приложение на 2 февруари 2025 г. и забранява конкретни AI практики, които се считат за несъвместими с европейските ценности.

Забранено е социалното скоринг — системи, които оценяват или класифицират хора въз основа на тяхното социално поведение или лични характеристики, водещо до неблагоприятно третиране. Забранена е и биометричната категоризация, която извежда чувствителни данни като расов произход, политически убеждения или сексуална ориентация. Системите за разпознаване на емоции на работното място и в образователните институции също са забранени.

Забранени са и манипулативните AI системи, които използват подсъзнателни техники или се възползват от уязвимостта на хора (деца, хора с увреждания) с цел изкривяване на поведението им. Реалновременното биометрично разпознаване в публични пространства е забранено с ограничени изключения за правоприлагащите органи.

Нарушенията на тези забрани подлежат на най-тежките санкции по закона: до 35 млн. EUR или 7% от годишния световен оборот, което е по-високото от двете.

EU AI Act: Какви са глобите и наказанията?

EU AI Act предвижда четири нива на санкции, приложими върху световния оборот на компанията — не само европейския.

| Нарушение | Максимална глоба | % от оборота |

|---|---|---|

| Запретени практики (Член 5) | 35 млн. EUR | 7% от световния оборот |

| Други нарушения на задълженията | 15 млн. EUR | 3% от световния оборот |

| Подвеждаща информация към органи | 7,5 млн. EUR | 1% от световния оборот |

| Нарушения от GPAI провайдъри | 15 млн. EUR | 3% от световния оборот |

За сравнение: GDPR предвижда максимални глоби до 20 млн. EUR или 4% от световния годишен оборот. EU AI Act надвишава тези прагове при най-сериозните нарушения.

При определяне на размера на глобите националните органи трябва да вземат предвид икономическата жизнеспособност на МСП и стартъпи. Въпреки това основните задължения се прилагат и за малките компании.

Временна линия на EU AI Act: Кога влизат в сила разпоредбите?

| Дата | Събитие | Засегнати компании | Необходими действия |

|---|---|---|---|

| 1 август 2024 | Влизане в сила на закона | Всички | Запознаване с изискванията |

| 2 ноември 2024 | Краен срок за членовете | Национални органи | Идентифициране на органи за защита на фундаментални права |

| 2 февруари 2025 | Запретени практики + AI грамотност | Всички разработчици и внедрители | Преглед и спиране на забранени системи; обучение на служители |

| 2 май 2025 | AI регулаторни пясъчници | Национални органи | Установяване на поне един пясъчник |

| 2 август 2025 | GPAI модели + AI Office | GPAI провайдъри | Техническа документация, политики за авторски права |

| 2 август 2026 | Пълна приложимост | Всички разработчици на висок риск системи | Пълно съответствие с всички изисквания |

| 2 август 2027 | Окончателен краен срок | GPAI провайдъри с системи преди август 2025 | Финално привеждане в съответствие |

EU AI Act: Какви са изискванията за висок риск AI системи?

Разпоредбите за висок риск AI системи влизат в пълна сила на 2 август 2026 г. Разработчиците и внедрителите на такива системи са засегнати от най-строгите изисквания по закона.

Висок риск системите включват: AI в продукти с EU изисквания за безопасност (медицински устройства, автомобили), системи за управление на критична инфраструктура, AI за подбор и оценка на персонал, системи за кредитен скоринг и застраховки, и AI в правосъдието и правоприлагането. Темата за AI и работните места е пряко свързана с тези изисквания — системите за наемане са сред най-строго регулираните.

Конкретните изисквания за висок риск системи включват:

- Система за управление на риска — непрекъснат процес през целия жизнен цикъл на системата

- Техническа документация — описание на системата, данни за обучение, резултати от тестване

- Управление на данните — изисквания за качество на обучаващите данни

- Оценка на съответствието — преди пускане на пазара

- Човешки надзор — Член 14 изисква задължителен човешки надзор на висок риск системи

- Мониторинг след пазара — редовни актуализации на базата на оперативния опит

EU AI Act: Какви са изискванията за GPAI модели като ChatGPT и Claude?

GPAI (General Purpose AI) моделите са системи с широка функционалност, обучени на големи обеми данни — ChatGPT, Claude, Gemini и подобни. Изискванията за тях влязоха в сила на 2 август 2025 г.

Провайдърите на GPAI модели трябва да изпълнят четири основни задължения: да изготвят и поддържат техническа документация, достъпна за AI Office и национални регулатори; да гарантират политики за съответствие с EU законодателството за авторски права; да предоставят подробно резюме на съдържанието, използвано за обучение на модела; и да управляват рисковете, свързани с модела.

На 18 юли 2025 г. Европейската комисия публикува проект на насоки, уточняващи ключови разпоредби на EU AI Act, приложими към GPAI модели. AI Office, оперативен от 2 август 2025 г., надзирава спазването на тези изисквания. Нарушенията от GPAI провайдъри подлежат на глоби до 15 млн. EUR или 3% от световния годишен оборот.

За по-широк контекст относно AI агенти и автоматизация — категория, която все по-тясно се припокрива с GPAI регулацията — вижте нашия анализ.

EU AI Act: Трябва ли да обучавам служителите си по AI грамотност?

От 2 февруари 2025 г. Член 4 на EU AI Act е в сила. Той задължава всички компании, които разработват, разпределят или управляват AI системи, да гарантират, че техните служители и външни доставчици са обучени по AI грамотност.

Обучението трябва да обхваща: как функционират AI системите, рисковете, свързани с конкретните системи, използвани в организацията, и как да се идентифицира неправилна употреба. Задължението се прилага за всички нива на организацията — от разработчиците до мениджмънта.

Практически стъпки включват разработване на базови курсове по AI грамотност, специализирани програми за технически персонал, и включване на изисквания за AI грамотност в договорните споразумения с трети страни.

EU AI Act vs GDPR: Каква е разликата?

| Аспект | GDPR | EU AI Act |

|---|---|---|

| Фокус | Защита на лични данни | Безопасност на AI продукти |

| Обхват | Само при обработка на лични данни | Дори без лични данни |

| Максимална глоба | 20 млн. EUR или 4% от оборота | 35 млн. EUR или 7% от оборота |

| Надзорен орган | Органи за защита на данни | Национални компетентни органи + AI Office |

| В сила от | 25 май 2018 г. | 1 август 2024 г. (поетапно) |

| Приложимост | При обработка на лични данни | При разработване/внедряване на AI системи |

Интегралната разлика между двата закона е, че GDPR е закон за фундаменталните права при обработка на данни, докато EU AI Act е закон за безопасността на продукта — конкретно за AI системите.

Двата закона могат да се прилагат едновременно. Например AI система за разпознаване на лица, която обработва биометрични данни, попада едновременно под GDPR (лични данни) и EU AI Act (висок риск или забранена практика). Напрежението между изискванията на AI Act за откритие на отклонения и защитата на чувствителните данни по GDPR е конкретно предизвикателство за компаниите.

GDPR надзорът се осъществява от националните органи за защита на данни (в България — КЗЛД), докато AI Act въвежда нови структури с национални компетентни органи, чието установяване в България предстои.

EU AI Act: Как да подготвя бизнеса си до август 2026?

- ✓Ранната класификация на AI системите спестява значителни ресурси по-късно

- ✓Регулаторните пясъчници позволяват тестване с облекчени изисквания

- ✓МСП имат специални разглеждания при определяне на глоби

- ✓Съответствието изгражда доверие у клиенти и партньори

- ✓Единна рамка за целия ЕС - едно съответствие за 27 пазара

- ×Значителни разходи за документация и оценки на съответствието

- ×Кратък срок до август 2026 за висок риск системи

- ×Изискванията за AI грамотност са в сила вече от февруари 2025

- ×Паралелното съответствие с GDPR и AI Act е сложно

- ×Националните органи в България все още не са установени

Петте конкретни стъпки за подготовка до 2 август 2026 г.:

Стъпка 1: Класифицирайте вашите AI системи — Определете ролята на вашата компания в AI стойностната верига (разработчик, дистрибутор, внедрител) и класифицирайте всяка система по четирите нива на риск. Системите за наемане, кредитен скоринг и медицинска диагностика автоматично са висок риск.

Стъпка 2: Установете система за управление на риска — Идентифицирайте потенциалните рискове за всяка AI система и внедрете мерки за тяхното намаляване. Управлението на риска трябва да е непрекъснат процес, не еднократна проверка.

Стъпка 3: Подгответе техническа документация — За висок риск системи документацията включва описание на системата, данните за обучение, резултатите от тестване и оценките на риска. Тази документация е основата за съответствие при проверки.

Стъпка 4: Обучете служителите по AI грамотност — Това задължение е в сила от февруари 2025 г. Разработете курсове, обхващащи функционирането на AI, рисковете и идентифицирането на неправилна употреба. Включете изискванията в договорите с външни доставчици.

Стъпка 5: Внедрете човешки надзор — За висок риск системи Член 14 изисква задължителен човешки надзор. Определете конкретни роли и процедури за надзор преди пускане на системата в употреба.

За практически примери как AI автоматизация за бизнес може да се внедри при спазване на регулаторните изисквания, вижте нашето ръководство.

EU AI Act: Кой надзирава съответствието?

AI Office официално стана оперативен на 2 август 2025 г. и е установен в Европейската комисия. Той играе централна роля в прилагането на EU AI Act, особено по отношение на GPAI модели.

От същата дата функционира и AI Board — формален координационен орган на ЕС, съставен от представители на държавите членки. AI Board помага на Комисията и членовете да осигурят последователно прилагане на закона. Европейската комисия е обявила и повикване за кандидатури за научна панел от независими експерти, фокусиран върху GPAI модели.

Националните органи за надзор на пазара ще извършват повечето разследвания за съответствие. В България тези органи предстои да бъдат установени — това е едно от задълженията на страната ни до 2 август 2026 г.

EU AI Act: Какво представляват регулаторните пясъчници?

Държавите членки трябва да установят поне един AI регулаторен пясъчник на национално ниво. Крайният срок за установяване беше 2 май 2025 г., а пълната функционалност се очаква до 2 август 2026 г.

Пясъчниците позволяват на компаниите да тестват иновативни AI системи под надзора на регулаторите, с облекчени изисквания. Те са особено полезни за стартъпи и МСП, които нямат ресурсите за пълна оценка на съответствието преди тестване на пазара.

България трябва да установи национален пясъчник, който ще дава на местните компании възможност да разработват и тестват AI системи в регулирана среда, преди пълното им пускане на пазара.

EU AI Act: Как засяга българските компании?

EU AI Act се прилага пряко в България като регламент на ЕС — без необходимост от транспониране в националното законодателство. Всяка българска компания, която разработва или внедрява AI системи за европейския пазар, е задължена да спазва закона.

Министерството на електронното управление е водещата институция за прилагане на AI Act в България, а Министерството на икономиката и енергетиката е определено за координираща роля от Съвета по европейски въпроси. Към март 2026 г. подготовката е в начална фаза — няма финални решения за координационния модел, надзора на висок риск системи и националните правила за прилагане, според БТА.

С Решение на МС № 398 от 18 юни 2025 г. са определени седем органа за защита на фундаменталните права: Омбудсман, ЦИК, КЗД, КЗЛД, КЗП, ДАЗД и ИА „Главна инспекция по труда". Все още не е назначен нотифициращ орган (подготвен е проект за Българска служба за акредитация) и не е установен пазарен надзор.

"Основните предизвикателства са липсата на достатъчен експертен капацитет, нуждата от техническа инфраструктура и сложното междуинституционално взаимодействие." — Министерство на електронното управление, БТА

Официалният текст на EU AI Act на български език е достъпен на: https://eur-lex.europa.eu/legal-content/BG/TXT/?uri=CELEX:32024R1689. Страницата на AI Office е на адрес: https://ai-office.ec.europa.eu/. За пълна информация за националните планове на всички държави членки, вижте AI Act National Implementation Plans.

EU AI Act: Какво следва след август 2026?

До 2 август 2026 г. трябва да влязат в пълна сила разпоредбите за висок риск AI системи. Окончателният краен срок за GPAI провайдъри, чиито системи са били в употреба преди август 2025 г., е 2 август 2027 г.

Европейската комисия продължава да публикува насоки и кодекси за практика. На 18 юли 2025 г. бяха публикувани насоки за GPAI модели. Очакват се допълнителни технически стандарти и указания от AI Office.

Често задавани въпроси

Кога точно влиза в пълна сила EU AI Act?+

Какви са максималните глоби по EU AI Act?+

Прилага ли се EU AI Act за малки компании и стартъпи?+

Каква е разликата между EU AI Act и GDPR?+

Кои AI системи са напълно забранени по EU AI Act?+

Трябва ли да обучавам служителите си по AI грамотност?+

Заключение

EU AI Act е конкретна регулаторна реалност, не бъдещо задължение. Забраните са в сила от февруари 2025 г., изискванията за AI грамотност — също. До 2 август 2026 г. всяка компания, използваща висок риск AI системи на европейския пазар, трябва да е в пълно съответствие.

За българските компании приоритетите са ясни: класифицирайте вашите AI системи сега, установете система за управление на риска и обучете служителите. Ранната подготовка е по-евтина от глобите.

Допълнителни ресурси

Основател на CyberNinjas.ai и Кибер Хора. Пише за AI инструменти, новини и практически ръководства.

Още статии

AI Новини11 мин.

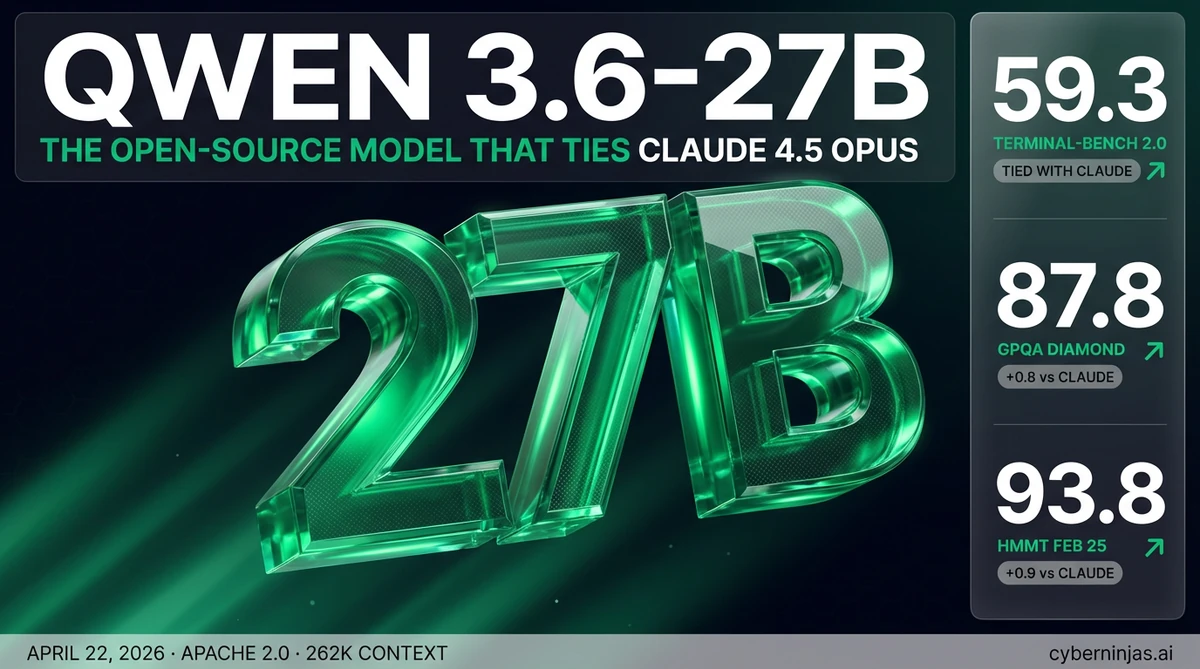

AI Новини11 мин.Qwen 3.6-27B: dense модел и benchmarks vs Claude [2026]

Qwen 3.6-27B пуснат на 22.04.2026 от Alibaba — моделът изравнява или надминава Claude 4.5 Opus на три теста. SWE-bench, GPQA, MMLU числа и БГ контекст.

AI Новини11 мин.

AI Новини11 мин.Vercel хак: Context.ai отвори вратата на хакерите [2026]

Vercel хак през Context.ai: AI инструмент стана supply chain backdoor. Пълна анатомия на атаката от 19.04.2026, какво откраднаха и как да се защитите.

AI Новини12 мин.

AI Новини12 мин.Meta Muse Spark: първият proprietary AI модел [2026]

Meta Muse Spark — първият proprietary модел от Meta Superintelligence Labs (08.04.2026). Multimodal reasoning, силни benchmarks и какво означава за БГ [2026]