Anthropic съди Пентагона: AI safety срещу военна употреба [2026]

Anthropic заведе дело срещу Пентагона след blacklist за supply chain risk. Компанията отказва Claude за автономни оръжия и масово наблюдение. Пълен анализ [2026].

На 24 март 2026 г. в Сан Франциско, федерален съдия разглежда делото, което може да определи бъдещето на AI индустрията: Anthropic — създателите на Claude — срещу Министерството на отбраната на САЩ. Компанията отказва моделът й да се използва за автономни оръжия и масово наблюдение на американски граждани. Пентагонът отговаря с безпрецедентно решение — обявява Anthropic за "заплаха за националната сигурност".

Накратко: Anthropic съди Пентагона след като администрацията на Тръмп я обяви за "supply chain risk" — етикет, използван преди само срещу чужди компании като Huawei. Причината: Anthropic отказва Claude да се ползва за автономни оръжия и масово наблюдение. Делото повдига конституционен въпрос — има ли AI компания право да откаже военна употреба, или правителството определя правилата? Заседанието е на 24 март 2026 г. пред Judge Rita Lin.

Хронология на конфликта Anthropic срещу Пентагона

Конфликтът не избухна внезапно — той се натрупва от месеци.

| Дата | Събитие |

|---|---|

| 2025 | Anthropic подписва $200M договор с Пентагона за classified systems |

| Февруари 2026 | Среща между Dario Amodei (CEO, Anthropic) и Pete Hegseth (Secretary of Defense) |

| Февруари 2026 | Тръмп обявява отношенията с Anthropic за прекратени |

| 6 март 2026 | Пентагонът обявява Anthropic за "supply chain risk" — ефективна забрана |

| 9 март 2026 | Anthropic завежда 2 федерални дела срещу администрацията |

| 16 март 2026 | Tech индустрията застава зад Anthropic — amicus briefs |

| 20 март 2026 | Съдебно документ разкрива: Пентагонът казал на Anthropic, че страните "са почти съгласни" — седмица след като Тръмп прекратил отношенията |

| 24 март 2026 | Заседание пред Judge Rita Lin в Сан Франциско |

Двете червени линии на Anthropic

Целият конфликт се свежда до две условия, които Anthropic отказва да прекрачи.

1. Без автономни оръжия

Anthropic настоява, че Claude не може да се използва за летално автономно оръжие без човешки контрол. Това означава: AI моделът не трябва самостоятелно да взема решения за употреба на сила — винаги трябва да има "human in the loop".

Позицията е в синхрон с етичните принципи за AI, споделяни от повечето frontier AI лаборатории. Но Пентагонът вижда нещата различно — в бойна обстановка, забавянето от човешки контрол може да коства животи.

2. Без масово наблюдение на американски граждани

Втората червена линия е забрана за използване на Claude за масово наблюдение (mass surveillance) на граждани на САЩ. Anthropic счита, че AI модел с възможностите на Claude — разбиране на контекст, анализ на огромни масиви от данни, генериране на заключения — е твърде мощен, за да бъде насочен срещу собственото население.

Позицията на Пентагона

Пентагонът отхвърля рамкирането на Anthropic. Военното министерство твърди, че:

- Всички употреби на Claude ще бъдат "законни" (lawful)

- Частна компания не може да диктува как правителството използва технологията си

- В ситуация на национална сигурност, оперативните решения не могат да зависят от корпоративни "червени линии"

- Съществува реален риск Anthropic да деактивира технологията по време на военна операция, ако прецени, че "червените линии" са преминати

Последният аргумент е особено интересен: Пентагонът се притеснява, че Anthropic може едностранно да "изключи" Claude в разгара на бойни действия — нещо, което никой военен командир не би приел.

Supply Chain Risk: безпрецедентен етикет срещу американска компания

На 6 март 2026 г. Пентагонът обяви Anthropic за "supply chain risk" — обозначение, което до този момент е прилагано само срещу чужди компании, като Huawei и Kaspersky.

Какво означава supply chain risk на практика

Последиците са разрушителни:

- Всички доставчици на Пентагона трябва да сертифицират, че нямат връзка с Anthropic

- Компании като AWS, Google Cloud и Azure — които хостват Claude — може да бъдат принудени да го премахнат

- Над 100 клиента на Anthropic вече са спрели или анулирали договори — от фармация до финтех

- Тръмп разшири забраната към всички федерални агенции — не само военните

Anthropic описва обозначението като "безпрецедентно и незаконно" — използване на закон, предназначен за чужди противници, като наказание за вътрешна компания заради нейните публично изразени позиции. В 48-страничния иск, публикуван от CBS News, компанията заявява: "The Constitution does not allow the government to wield its enormous power to punish a company for its protected speech."

- ✓Anthropic защитава принципа, че AI компаниите имат право на етични граници

- ✓Създава прецедент за AI safety стандарти в отбраната

- ✓First Amendment аргументът защитава правото на компаниите да отказват определени употреби

- ✓Подкрепа от OpenAI, Google DeepMind, EFF, Cato Institute — широка коалиция

- ✓Разкрива злоупотреба със supply chain risk закон срещу вътрешна компания

- ×Правителството трябва да контролира критична военна технология, не частни компании

- ×AI компания не може да има вето над оперативни военни решения

- ×Рискът от деактивация на AI по време на бойна операция е реален

- ×Конкурентите (OpenAI, xAI) вече запълват вакуума — Anthropic губи позиции

- ×Supply chain risk етикетът вреди на всички AI компании, не само на Anthropic

Правният аргумент: First Amendment и правото да кажеш "не"

Anthropic не се защитава само с бизнес аргументи — тя повдига конституционен въпрос.

Аргументът на Anthropic

В 48-страничен иск, подаден в U.S. District Court за Северна Калифорния, Anthropic твърди:

"The federal government retaliated against a leading frontier AI developer for adhering to its protected viewpoint on a subject of great public significance."

Логиката е: Anthropic публично изрази позиция за AI safety (защитено мнение по First Amendment) → Пентагонът я наказа за тази позиция → Това е правителствено отмъщение за свободно изразяване.

Контра-аргументът на DOJ

Министерството на правосъдието оспорва First Amendment аргумента, като твърди, че отказът на Anthropic да приеме договорните условия на правителството е действие (conduct), не реч (speech). Разликата е юридически значима — First Amendment защитава реч, но не гарантира право на правителствен договор при условия, определени от компанията.

Кой подкрепя Anthropic

Подкрепата е впечатляваща и cross-partisan:

- Десетки учени от OpenAI и Google DeepMind — amicus brief в лично качество

- Electronic Frontier Foundation (EFF) — водеща организация за дигитални права

- Cato Institute — либертариански think tank

- Chamber of Progress — tech индустриална група

- First Amendment Lawyers Association — юридическа асоциация

- Foundation for Individual Rights and Expression (FIRE) — правозащитна организация

Тази коалиция от ляво до дясно е рядкост — и показва, че делото надхвърля партийните линии.

Геополитическите залози: AI надпреварата с Китай

Делото има измерение отвъд конституционното право — то засяга глобалната AI надпревара.

Парадоксът на ограничаването

Критиците на Пентагона посочват ирония: докато американски компании се самоограничават, китайски лаборатории вече са дистилирали моделите на Anthropic и OpenAI в open-source версии като DeepSeek — достъпни без ограничения за НОАК, Иран и всеки друг актьор.

Кой запълва вакуума

Докато Anthropic се бори в съда, конкурентите действат:

| Компания | Позиция към военна употреба | Действие |

|---|---|---|

| Anthropic | Отказва автономни оръжия + наблюдение | Съди Пентагона, загубва $200M договор |

| OpenAI | Приема военни контракти | Запълва вакуума след Anthropic |

| xAI (Мъск) | Отворена към сътрудничество | Строи Terafab за военни AI чипове |

| Google DeepMind | Учени подкрепят Anthropic (лично) | Официално — без позиция |

| Meta | Отворена към сътрудничество | Придобива Dreamer за Superintelligence Labs |

Резултатът е парадоксален: компанията с най-строгите AI safety стандарти е наказана, а тези с по-малко ограничения получават военните контракти. Това създава обратен стимул — "не бъди safety-first, ако искаш правителствени пари".

Какво казва Vinod Khosla

Венчър капиталистът Vinod Khosla — един от най-уважаваните гласове в Silicon Valley — улавя напрежението перфектно: той "възхищава се на принципите на Anthropic", но не е съгласен, че частна компания трябва да има право на вето над военни операции. Въпросът е фундаментален: кой трябва да решава границите на AI — избраните политици или tech CEO-тата, които създават технологията?

В контекста на EU AI Act — европейският подход дава отговор чрез регулация, не чрез корпоративна самоцензура. Но в САЩ, където AI регулацията все още е фрагментирана, делото Anthropic vs. Пентагон може де факто да зададе правилата за цялата индустрия.

Финансовите щети вече са реални

Загубата на $200 милиона от Пентагон контракта е само началото. По-опасното е каскадният ефект: над 100 enterprise клиента вече спряха договорите си. Фармацевтични компании, финтех фирми и консултантски гиганти — всички зависещи от федерални контракти — не могат да рискуват да бъдат свързани с "supply chain risk" компания. Claude може да е по-добър от ChatGPT в legal reasoning и cybersecurity — но ако клиентите бягат, техническото превъзходство не помага.

Какво означава делото за AI индустрията

Независимо от решението на Judge Rita Lin, делото Anthropic vs. Пентагон вече промени ландшафта.

За AI компаниите

- Прецедент за supply chain risk — ако Пентагонът може да го приложи срещу вътрешна компания, всяка AI фирма е уязвима

- First Amendment за AI — дали компаниите имат конституционно право да откажат определени употреби

- Обратен стимул — safety-first подход може да доведе до загуба на правителствени договори

- Клиентски exodus — 100+ клиента вече напуснаха Anthropic заради етикета

За AI разработчиците

Делото директно засяга всеки, който работи с AI агенти или разработва AI продукти за enterprise. Ако правителството може да наложи supply chain risk етикет на AI компания заради нейната safety политика, това създава chilling effect — компаниите ще се самоцензурират, за да не загубят клиенти.

За потребителите

Claude продължава да работи за обикновени потребители. Но ако AWS, Google Cloud или Azure бъдат принудени да сертифицират "нулева връзка с Anthropic" за федерални клиенти, инфраструктурните последици могат да засегнат и потребителските AI услуги.

Заседанието на 24 март: какво очакваме

Заседанието пред U.S. District Judge Rita Lin е насрочено за 13:30 PT (23:30 българско време) в Сан Франциско.

Anthropic иска:

- Preliminary injunction — временна заповед, спираща supply chain risk обозначението

- Отмяна на заповедта на Тръмп, забраняваща Claude за всички федерални агенции

- Признаване, че обозначението е незаконно отмъщение за защитена реч

Пентагонът защитава:

- Правото на правителството да определя условията за военно използване на технологии

- Supply chain risk обозначението е законно упражняване на изпълнителна власт

- Anthropic няма конституционно право на правителствен договор при собствени условия

Judge Rita Lin може да постанови решение на заседанието или да издаде писмено решение в следващите дни. Резултатът ще бъде определящ за бъдещето на AI регулацията — не само в САЩ, а глобално.

Въпроси и отговори за делото Anthropic срещу Пентагона

Защо Anthropic съди Пентагона?+

Какво е supply chain risk обозначение?+

Claude все още работи ли за обикновени потребители?+

Кой подкрепя Anthropic в делото?+

Какви са двете червени линии на Anthropic?+

Как делото засяга AI индустрията?+

Заключение: делото, което ще определи AI етиката за десетилетие

Anthropic vs. Пентагон не е обикновено корпоративно дело. Това е тестът за AI индустрията — дали компаниите, които създават най-мощните технологии в историята, имат право да поставят етични граници, или правителството определя правилата без възражения.

Парадоксът е жесток: Anthropic — компанията, основана изрично за безопасен AI — е наказана точно заради тази мисия. Конкурентите, които не поставят ограничения, получават контрактите. Ако този модел се наложи, стимулът за AI safety изчезва — и остава само надпреварата за мощност без етични граници.

Каквото и да реши Judge Rita Lin, делото вече промени играта. Въпросът "кой контролира AI?" вече не е философски — той е юридически, политически и геополитически. Отговорът ще определи не само бъдещето на Anthropic, а на цялата AI индустрия за следващото десетилетие.

Основател на CyberNinjas.ai и Кибер Хора. Пише за AI инструменти, новини и практически ръководства.

Още статии

AI Новини11 мин.

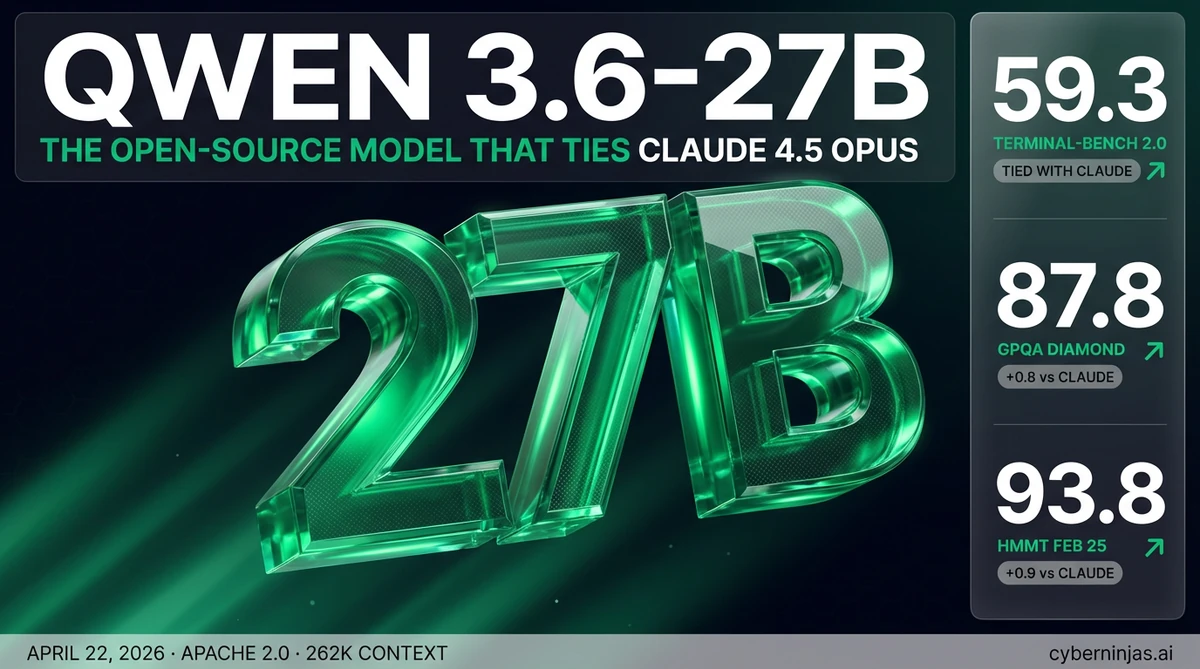

AI Новини11 мин.Qwen 3.6-27B: dense модел и benchmarks vs Claude [2026]

Qwen 3.6-27B пуснат на 22.04.2026 от Alibaba — моделът изравнява или надминава Claude 4.5 Opus на три теста. SWE-bench, GPQA, MMLU числа и БГ контекст.

AI Новини11 мин.

AI Новини11 мин.Vercel хак: Context.ai отвори вратата на хакерите [2026]

Vercel хак през Context.ai: AI инструмент стана supply chain backdoor. Пълна анатомия на атаката от 19.04.2026, какво откраднаха и как да се защитите.

AI Новини12 мин.

AI Новини12 мин.Meta Muse Spark: първият proprietary AI модел [2026]

Meta Muse Spark — първият proprietary модел от Meta Superintelligence Labs (08.04.2026). Multimodal reasoning, силни benchmarks и какво означава за БГ [2026]